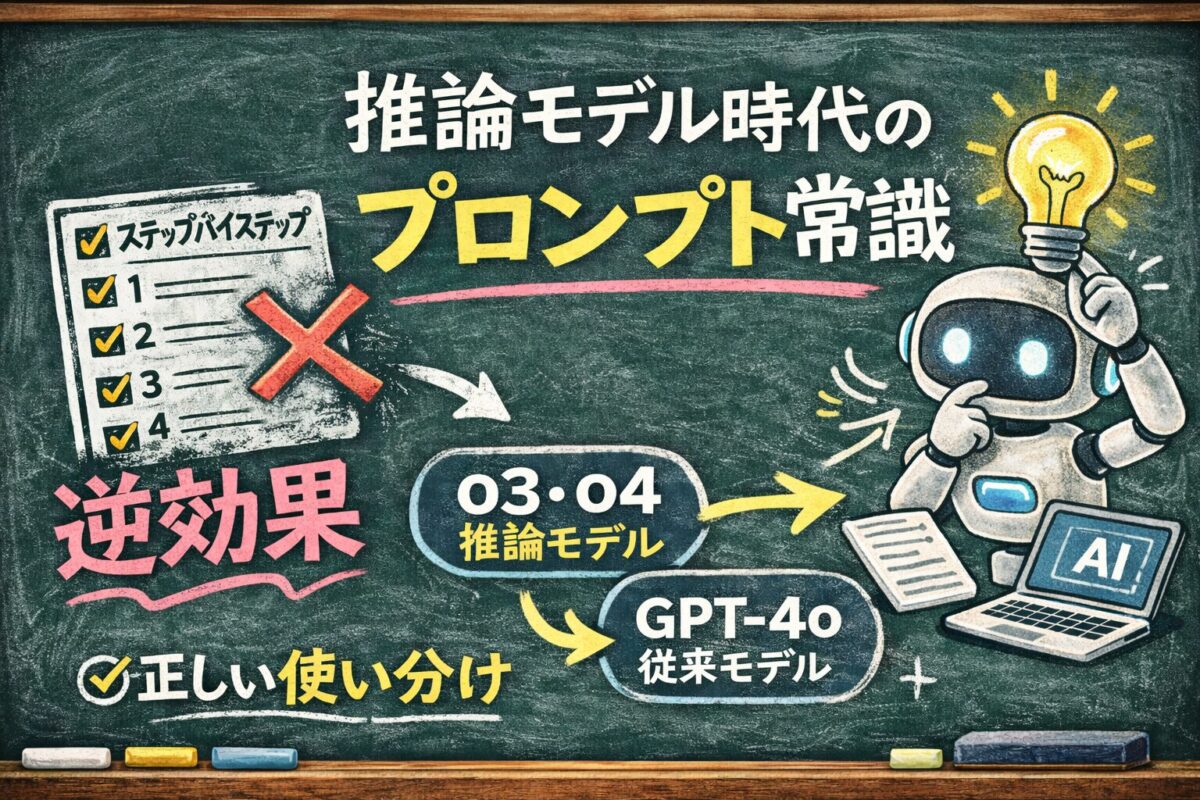

「ステップバイステップで考えてください」——これはAIプロンプトの定番テクニックだった。

2024年にOpenAIがo1を発表したとき、この常識が覆された。推論モデルは内部で既に思考プロセスを経ているため、「ステップバイステップ」の指示がむしろパフォーマンスを妨げると公式が発表したのだ。

2026年3月現在、推論モデルはo3・o4-mini・Claude Opus 4.6等が主流となり、汎用モデル(GPT-4o・Claude Sonnet等)との使い分けは「どのタスクに使うか」だけでなく「プロンプトの書き方」まで変わってきている。

情シスとして社内のAI活用研修を担当する中で、「同じプロンプトの書き方を全モデルに使っている」ケースが最も多い失敗パターンだ。本記事で2026年の新常識を整理する。

この記事でわかること

- 推論モデルとは何か・汎用モデル(GPT-4o等)と何が根本的に違うのか

- 「ステップバイステップ」がなぜ推論モデルで逆効果になるのか

- 2026年現在の推論モデル別プロンプト設計の新常識

推論モデルとは何か?汎用モデルとの根本的な違い

📌 要点:推論モデル(o3・o4-mini・Claude Opus等)は複雑な問題を解く前に「内部で思考プロセス」を経る。汎用モデルは「知っていることを答える」モデル。この違いがプロンプト設計に直結する。

汎用モデル(GPT-4o・Claude Sonnet等)

「知っていることを素早く答える」モデルだ。日常的な文章生成・要約・翻訳・簡単な質問応答に向いている。応答速度が速く、APIコストが低い。

推論モデル(o3・o4-mini・Claude Opus 4.6等)

「複雑な問題を解く前に内部で思考プロセスを経る」モデルだ。回答前に「どうアプローチすべきか」を自律的に検討するため、回答時間は長くなる。

2026年3月現在の主要推論モデルはこうなる。

| モデル | 特徴 | 主な用途 |

|---|---|---|

| OpenAI o3 | 高精度推論・コーディング特化 | 複雑な論理問題・コード生成 |

| OpenAI o4-mini | o3の軽量版・コスト効率◎ | 数学・多段推論・コスト重視 |

| Claude Opus 4.6 | 高度な推論・文脈理解 | 長文分析・複雑な戦略立案 |

| Gemini 2.5 Pro | 推論+大容量コンテキスト | 大量資料の横断分析 |

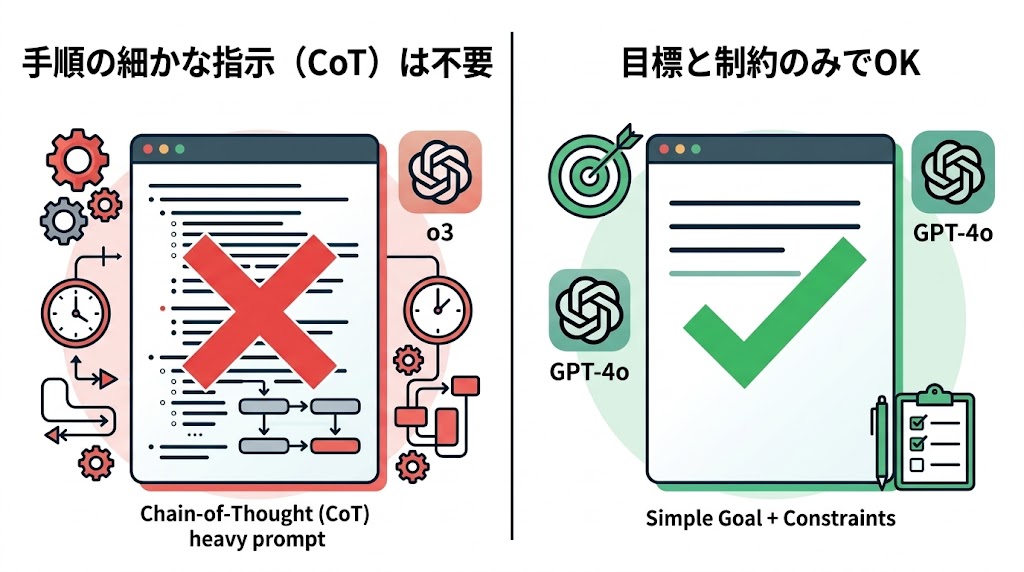

「ステップバイステップ」がなぜ逆効果になるのか

📌 要点:推論モデルは内部で既に「思考の連鎖(Chain-of-Thought)」を自律実行している。外部から「ステップバイステップで考えて」と指示すると、内部の推論プロセスと競合して精度が下がる場合がある。

汎用モデルでは効果的だった以下の手法が、推論モデルでは逆効果になることがある。

推論モデルで避けるべき指示:

- 「ステップバイステップで考えてください」(Chain-of-Thought指示)

- 「順を追って論理的に考えてください」

- 「まず〜を考えて、次に〜を考えて……」という細かい手順指定

- Few-shot(多数の例示)による誘導

なぜか: 推論モデルは既に内部でこれらのプロセスを自律実行している。外部からさらに「こう考えろ」と手順を指定すると、内部の推論プロセスと競合してノイズになる。

情シスとして社内テストをしたとき、o3に「ステップバイステップで考えて要件整理をしてください」と指示したプロンプトと、「要件をまとめよ」とシンプルに指示したプロンプトを比較した。後者の方が出力のキレが良く、冗長な「ステップ①〜」の羅列が消えて本質的な内容だけが返ってきた。

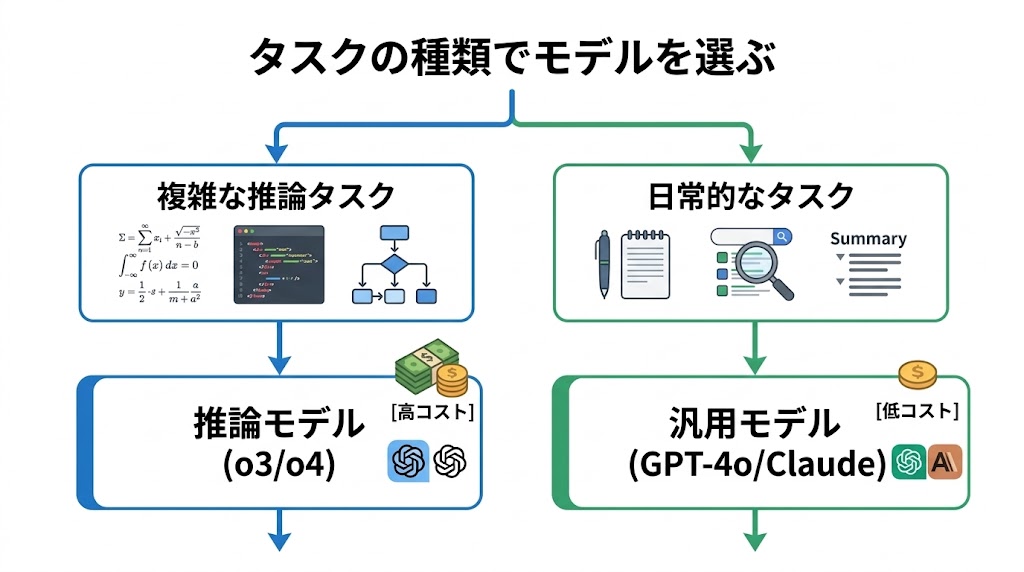

推論モデルと汎用モデルの使い分け

📌 要点:推論モデルは複雑な論理問題・数学・コーディング・多段階分析に向いている。汎用モデルは日常的な文章生成・翻訳・要約・検索的な質問応答に向いている。コストと速度の観点でも使い分けが重要。

推論モデル(o3・o4-mini・Claude Opus等)が向いているタスク:

- 複雑な論理推論・数学・科学的な問題解決

- 長大なコードのデバッグ・アーキテクチャ設計

- 矛盾する情報の整合性確認

- 多段階の条件分岐が必要な分析

汎用モデル(GPT-4o・Claude Sonnet等)が向いているタスク:

- メール・文章の生成・翻訳・要約

- 簡単な質問応答・情報検索的な使い方

- 画像認識・ファイル分析(推論モデルは非対応のものも多い)

- リアルタイムな対話が必要な用途

コストの観点: 推論モデルは内部の「思考プロセス」にもAPIコストが発生する。o3をすべての用途に使うと月額が急増する。単純なタスクは汎用モデルに任せ、推論モデルは複雑なタスクに絞って使うのがコスト最適解だ。

推論モデルに効くプロンプト設計の新常識

📌 要点:推論モデルには「ゴール(何を達成するか)と制約(何をしてはいけないか)」を明確にするだけでいい。細かい手順指定は不要。シンプルで直接的なプロンプトが最高のパフォーマンスを引き出す。

❌ 推論モデルには向かないプロンプト例

以下の問題を解いてください。

まず問題の要素を分解してください。

次に各要素を個別に検討してください。

その後、総合的な結論を導き出してください。

ステップバイステップで論理的に考えてください。✅ 推論モデルに向いているプロンプト例

### ゴール

[達成したいこと]

### 制約

・[してはいけないこと1]

・[してはいけないこと2]

### 出力形式

[期待する出力の型]推論モデルへの指示で押さえるべきポイントは3点だ。

- シンプルで直接的に書く:AIが自律的に考えられる余地を残す

- ゴールと境界線を明確にする:「何を達成するか」と「何をしてはいけないか」のみ定義

- 手順の細分化は省く:「どう考えるか」はモデルに任せる

FAQ

Q. o3とo4-miniはどちらを使えばいい?

精度最優先の複雑なタスクにはo3、コストを抑えながら推論が必要なタスクにはo4-miniが向いている。

まずo4-miniで試して、精度が不十分な場合にo3にアップグレードする順序が費用対効果が高い。

Q. 推論モデルはChatGPTの無料版で使える?

無料版ではGPT-4o系の汎用モデルが使える。

2026年3月時点では、推論モデル(o3等)の利用には有料プランが必要で、使用回数の制限もある。

Q. Claude Opus 4.6とo3はどちらが推論が優れている?

タスクによって異なる。

数学・コーディング・論理問題ではo3が強い傾向。長文の文脈理解・文章の質・倫理的判断が必要な推論ではClaude Opus 4.6が強い場面が多い。両方試して判断するのが現実的だ。

Q. 日常業務の文章作成にo3を使っても問題ない?

問題はないが費用対効果が悪い。

メール作成・要約・翻訳などは汎用モデル(GPT-4o・Claude Sonnet等)で十分な品質が出る。o3の応答には時間もかかるため、速度が重要な日常業務には向いていない。

Q. 「ステップバイステップ」の指示は全モデルで不要になった?

汎用モデルではまだ有効です。

GPT-4oやClaude Sonnetには引き続きCoT(思考の連鎖)指示が精度向上に効く。「ステップバイステップ不要」は推論モデル限定の話だ。

まとめ

- 推論モデル(o3・o4-mini・Claude Opus等)は内部で思考プロセスを自律実行する。外部からの手順指定は逆効果になることがある

- 「ステップバイステップ」は汎用モデルには有効、推論モデルには不要または逆効果

- 使い分けの基準:複雑な論理・数学・コードには推論モデル、日常的な文章生成・翻訳・要約には汎用モデル

- 推論モデルへのプロンプト:シンプルに「ゴール+制約」だけを明確にする。手順の細分化は省く

- コスト管理:推論モデルは内部思考にもAPIコストが発生する。用途を絞って使うことで費用対効果を最大化する

「全モデルに同じプロンプトの書き方をしている」なら、今日からモデルに合わせたプロンプト設計を始めてほしい。