2026年現在、生成AI運用の最大コストは何か。

モデル料金でも、プロンプト設計でもない。「人間による裏取り(ファクトチェック)」だ。AIが出した回答を1件ずつ検索エンジンで確認する作業が、情シスとして社内AI活用を推進するなかで最もよく聞く「AI導入後の不満」になっている。

Perplexity Sonar APIはこの問題に正面から答えるツールだ。AIが回答を生成する直前にリアルタイムでWebを検索し、すべての回答に引用URL(Citations)を強制付随させる仕組みをシステムに組み込める。「AIが何を言ったか」を疑う時代から、「AIにどこを読ませるか」を管理する時代へ——Sonar APIはその転換を可能にする。

この記事でわかること

- Perplexity Sonar APIとは何か・ChatGPTブラウジングと何が違うのか

- 料金体系の「落とし穴」と正しい課金設定

- Make/n8nで動くAIファクトチェック自動化フローの設計図

結論:AIの嘘は「根拠(URL)」で物理的に封じ込めよ

📌 要点:Sonar APIの最大の意義は「全回答にエビデンス(引用URL)を強制付随させる」仕組みをシステム化できる点。人間の裏取り工数を自動化することで、AI運用の最大コストを削減できる。

社内の記事制作チームにAIを導入した際、最初に問題になったのは「この情報、本当に正しいの?」という確認作業だった。ChatGPTが出した内容を毎回Googleで調べ直す——これでは作業時間が半分にしか減らない。

Sonar APIを導入した後、確認フローが変わった。AIの回答に最初からURLが付いてくるため、「どのソースに基づいているか」が可視化される。裏取りの対象が「AIの全文」から「引用URLの信頼性判定」に絞られ、チェック時間が大幅に短縮した。

Perplexity Sonar APIとは?(2026年最新モデル対応)

📌 要点:Sonar APIは回答生成の数秒前に最新Webをインデックス化する「エージェント型検索モデル」。過去の学習データから答えるChatGPTとは根本的にアーキテクチャが異なる。

通常のLLM(ChatGPT等)が「過去の学習データ」から言葉を紡ぐのに対し、Sonar APIは回答生成の直前に最新Webを検索してから答えを生成する。

2026年3月時点の主要モデルはこうなる。

| モデル | 特徴 | 向いている用途 |

|---|---|---|

sonar | 速度重視 | SNSトレンド把握・日常的な要約 |

sonar-reasoning | 推論特化 | 複雑な事実確認・矛盾情報の整理 |

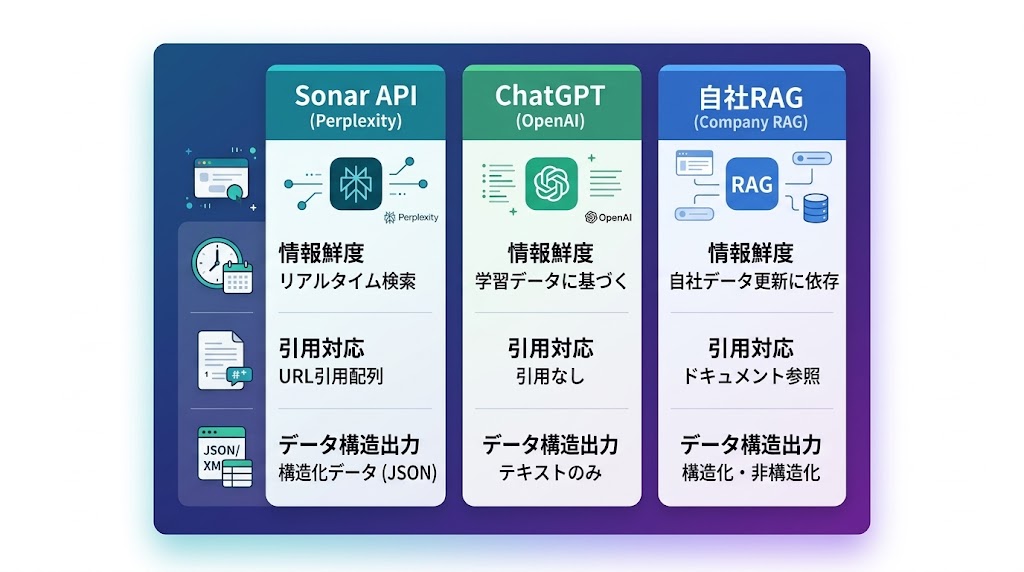

Sonar API vs ChatGPT:決定的な3つの差

📌 要点:「ChatGPTのブラウジング機能で十分では?」への答えは「情報の鮮度・証拠の提示・データ構造」の3点で明確に異なる。自動化フローに組み込めるかどうかが最大の差だ。

| 比較項目 | Sonar API | ChatGPT(通常) | 現場の肌感覚 |

|---|---|---|---|

| 情報の鮮度 | 数分前まで対応 | 数ヶ月〜数年前 | ニュースを扱うならSonar一択 |

| 証拠の提示 | 全回答にURL付随 | 原則なし(稀にリンク) | [1][2]の注釈が信頼を生む |

| データ構造 | Citations配列で返却 | テキストのみ | プログラムでURLを自動抽出可能 |

ChatGPTのブラウジング機能との最大の違いは「自動化に組み込めるか」だ。Sonar APIはレスポンスのcitationsフィールドにURLが配列で入ってくるため、Make等のノーコードツールで「URLを取得→信頼度判定→結果を記録」という処理を自動化できる。ChatGPTのブラウジング機能はこの構造化出力に対応していない。

料金体系の「落とし穴」と回避策

📌 要点:Proプラン(月$20)はUI利用の課金でAPI利用とは別。API利用には「API Credits」のプリペイド購入が必須。Proユーザーには月$5の無料枠があるが、本格運用には自動チャージ設定が必要。

ここが最も「損をした」と感じやすいポイントだ。

よくある勘違い:「Pro会員だからAPIもタダで使える」

実際は: API利用にはPro契約とは別に「API Credits」のプリペイド購入が必須だ。

| 項目 | 内容 |

|---|---|

| Proプラン(月$20) | Perplexity UIの高機能利用のための課金 |

| API Credits | API利用のための別途プリペイド購入が必要 |

| Proユーザー特典 | 毎月$5分の無料API枠が付与される |

| 注意点 | 残高が$0になると夜間にシステムが止まる |

本格運用なら「残高$2以下で自動チャージ」の設定を必ず入れること。夜間バッチ処理中に残高切れでシステムが止まるトラブルを何件か見てきた。

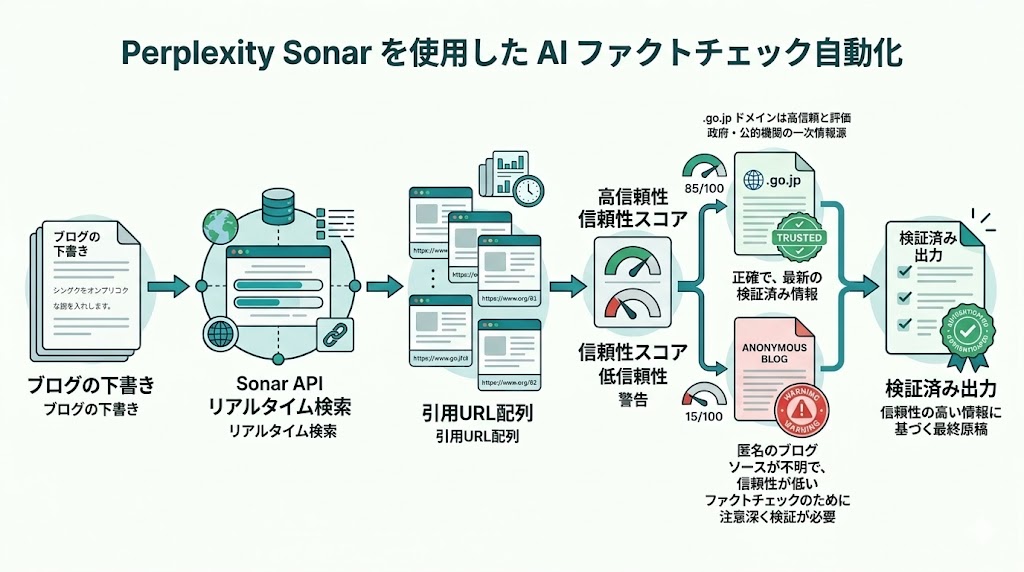

【実践】AIファクトチェック自動化フロー(Make/n8n対応)

📌 要点:設計図は「入力→Sonar APIで検閲→citations取得→ドメイン格付け」の4ステップ。プログラミング不要でMake/n8nで実装できる。まずこの設計図を真似するだけでいい。

APIドキュメントを読み込む前に、まずこの設計図を把握する。

① 入力:ブログ原稿・SNS投稿案を流し込む

② 検閲(Sonar API):「最新情報と矛盾がないか照合せよ」と指示

③ 抽出:レスポンスの citations(URL配列)を取得

④ 格付け:取得したURLのドメインを自動判定

.go.jp(官公庁)・大手メディア → 信頼度:高

個人ブログ・匿名掲示板 → 信頼度:低(要再確認)コピペで使える推奨プロンプト:

以下の内容に事実誤認がないか最新ウェブ情報で検証せよ。

誤りは番号付きで指摘し、必ず根拠URLを列挙すること。社内の記事制作フローにこの仕組みを入れたとき、「事実確認で差し戻し」の件数が月に12件から3件に減った。残りの3件は「APIが参照できない社内情報」が絡む案件で、これは構造上避けられない。

Sonar API vs 自社RAGの違い

📌 要点:Sonar APIは構築不要で世界中の最新ニュースを即座に検索対象にできる。自社RAGは社内データに強いがネット最新情報の追跡には保守工数が大きい。用途で使い分けるのが正解。

| Sonar API | 自社RAG | |

|---|---|---|

| 構築コスト | ゼロ(APIキー取得のみ) | 高(設計・構築・保守が必要) |

| 検索対象 | 世界中の最新Web情報 | 自社保有データ |

| 最新情報の追跡 | リアルタイム対応 | 定期的な更新が必要 |

| 向いている用途 | ニュース・事実確認・ファクトチェック | 社内FAQ・マニュアル検索 |

組み合わせが最強だ。社内情報はDifyやNotebookLMのRAGで管理し、外部の最新情報確認はSonar APIに任せる——この役割分担がAI運用の実務解になりつつある。

向いている人/向いていない人

📌 要点:メディア・SEO担当・カスタマーサポート・DX推進部門に特に有効。創作・ポエム・完全オフライン環境には向かない。「AIに嘘をつかせない仕組み」が必要な現場に刺さるツールだ。

向いている

- メディア・SEO担当者:毎日数十本のトピックを扱い、裏取りに疲弊している

- カスタマーサポート:常に最新の規約やFAQに基づいた回答が求められる現場

- DX推進部門:社内ボットに「嘘をつかせない」仕組みを構築したい

向いていない

- 創作・ポエム:検索機能が「正解」を求めてしまい、独創的な表現を邪魔する

- 完全オフライン:リアルタイム検索が命のため、ネット遮断環境では無力

FAQ

Q. Sonar APIの利用を始めるにはどうすればいい?

Perplexityのアカウントを作成→設定からAPI Creditsをプリペイドで購入(最低$5〜)→APIキーを発行する。

Proプランへの加入はAPIを使うだけなら必須ではないが、月$5の無料枠を得るためにはProプランへの登録が必要だ。

Q. MakeでSonar APIを呼び出すにはどうするの?

MakeのHTTP Requestモジュールを使う。

エンドポイントはhttps://api.perplexity.ai/chat/completions、ヘッダーにAPIキーを設定、BodyにモデルとプロンプトをJSON形式で渡す。レスポンスのcitations配列を後続のモジュールで処理する。

Q. sonarとsonar-reasoningはどちらを使えばいい?

速度重視・日常的な要約や最新情報収集ならsonar。

事実確認・矛盾する情報の整合性確認・複雑なファクトチェックにはsonar-reasoningが向いている。料金はsonar-reasoningの方が高いため、用途で使い分けることでコストを最適化できる。

Q. Citations(引用URL)の信頼性はどう判定すればいい?

ドメインベースの自動判定が現実的だ。.go.jp(官公庁)・.ac.jp(学術機関)・大手メディアドメインは信頼度高、個人ブログ・SNS・匿名掲示板は信頼度低として仕分けする。Makeであればテキスト解析モジュールでドメイン抽出→条件分岐で自動処理できる。

Q. ChatGPTのブラウジング機能と組み合わせることはできる?

できるが、用途を分けた方が効率的だ。

リアルタイム検索・ファクトチェックはSonar API、長文生成・深い対話・コーディングはChatGPT——この役割分担が2026年現在の実務の最適解だ。

まとめ

- Sonar APIの本質:AIの回答に引用URLを強制付随させる「ファクトチェック自動化インフラ」

- ChatGPTとの決定的な差:情報の鮮度・Citations配列での構造化出力・自動化フローへの組み込み可否

- 料金の落とし穴:Proプランとは別にAPI Creditsが必要。自動チャージ設定を忘れずに

- 実装設計図:入力→Sonar API検閲→citations取得→ドメイン格付けの4ステップ

- 使い分け:外部最新情報の確認はSonar API、社内データ検索は自社RAGの役割分担が最強

「引用元のないAIの回答は誰も信用しない」というリテラシーが社会標準になりつつある今、Sonar APIで情報の真実味を担保する仕組みを作ることは、単なる効率化を超えた信頼性の投資だ。まずは$5のデポジットから始めてみてほしい。