「自分の声が、知らない曲を歌わされている。」

AI音楽生成や音声ディープフェイクの普及により、これはもはやSFではなく2026年現在のリアルな脅威だ。

結論から言えば、現在の日本法は「声そのもの」を完全には保護していない。しかし「法的な立ち回り」と「最新の認証技術」を組み合わせれば、理論上の防衛ラインは構築できる。

この記事でわかること

- 日本の著作権法がなぜ「声の保護」に弱いのか

- ディープフェイク被害に遭ったときの機械的5ステップ

- 世界のNO FAKES法・EU AI Actの最新動向と日本への影響

日本の法律という「脆い盾」の正体

📌 要点:日本の著作権法第30条の4はAI学習に世界で最も「緩い」と言われる。「解析目的」なら原則として声の無断学習を許可しているが、「特定アーティストの声の完璧な再現」を目的とする場合は免責から外れる可能性が強まっている。

日本の著作権法第30条の4は、AI学習において世界で最も「緩い」と言われている。

- AI学習は原則自由:相手が「楽しむため」ではなく「解析するため」であれば、原則としてあなたの許可なく声を学習できる

- 「享受目的」の併存が争点:2026年現在、AIモデルが「特定アーティストの声を完璧に再現すること」を目的とする場合、この免責規定から外れる可能性が強まっている

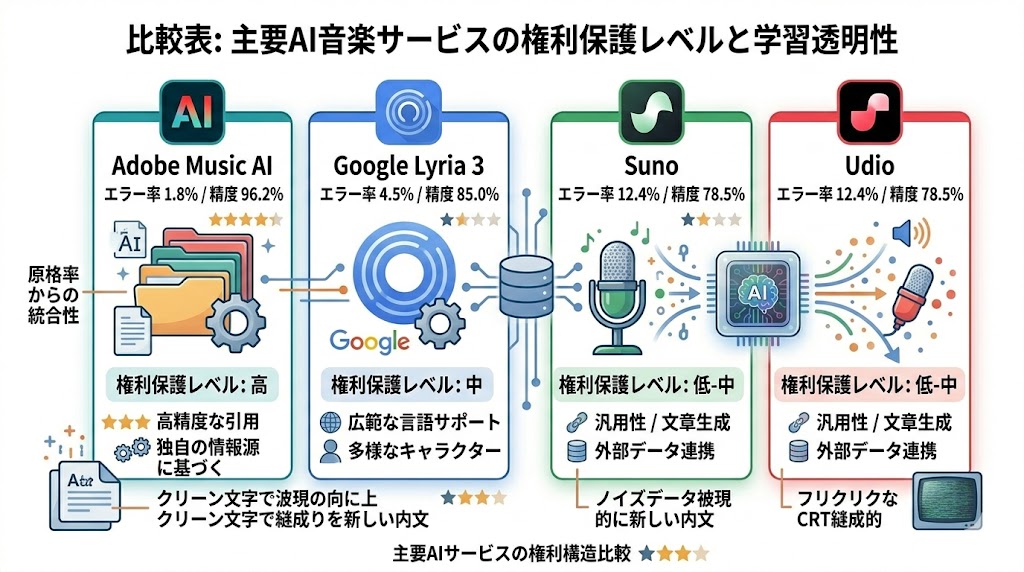

主要AIサービスの権利構造:「大手なら安心」は幻想

📌 要点:Adobe(許諾済み素材のみ)・Google Lyria 3(SynthIDによる透かし対応)・Suno/Udio(大手との和解は進むが一般人への配慮は事後通報頼み)と各社の姿勢は明確に分かれている。サービス選択は「権利保護レベル」も判断基準に入れるべきだ。

| サービス | 権利保護レベル | 学習データの透明性 | アドバイス |

|---|---|---|---|

| Adobe (Music AI) | 高 | 許諾済み素材のみ | 他人の権利は守るが自社素材としての学習は行われる |

| Google (Lyria 3) | 中 | 自社データ中心 | SynthID(電子透かし)によりAI生成の証跡が残る |

| Suno / Udio | 低〜中 | 非公開 | 大手レーベルとの和解が進む一方、一般人の声への配慮は「事後通報」頼み |

「声は著作物ではない」という不都合な真実

📌 要点:法律上、声質(声そのもの)は著作物ではなく「属性」にすぎない。「地声で話しているだけの音声」を真似されても著作権では訴えにくい。使うべき武器は著作権ではなく「パブリシティ権」と「人格権」だ。

法律上の定義を整理する。

- 声質(声そのもの):著作物ではない。「属性」とみなされる

- 歌唱・演技(表現):著作物になり得る

- 録音データ(音源):著作隣接権で守られる

「地声で喋っているだけの音声」をAIに真似されても、著作権で訴えるのは非常に困難だ。使うべき武器は著作権ではなく「パブリシティ権」や「人格権」だ。

ディープフェイク被害に遭った際の「機械的」5ステップ

📌 要点:感情的な怒りは横に置き、①証拠の完全保全②「なりすまし」としてのプライバシー侵害通報③弁護士名義での削除通知④発信者情報開示請求⑤Content CredentialsでSNSに本物の証明を固定——この5ステップを淡々と進める。

感情的な怒りは横に置き、以下の手順を淡々と進める。

① 証拠の完全保全:URLだけでなく、ブラウザのデバッグモード等でソースコードを含めた画面録画を行う。

② プラットフォームへの「プライバシー侵害」通報:著作権ではなく「なりすまし」によるガイドライン違反で攻めるのが最速だ。

③ 弁護士経由での「削除通知」:個人名ではなく弁護士名義で送るだけで、海外プラットフォームの対応優先度が変わる。

④ 発信者情報開示請求:2025年以降、AI悪用に対する開示請求のハードルは下がる傾向にある。

⑤ 「本物の証明」をSNSで固定:Content Credentials(C2PA)に対応した公式声明を出し、検索結果にぶつける。

世界の動向:2026年は「NO FAKES法」元年

📌 要点:米国でNO FAKES法が施行目前、EUはAI Actでディープフェイクへの明示義務を課した。日本でも「音声権」新設に向けた超党派議論が加速中。法制度整備のスピードはAI進化より遅く、今は「技術と法的立ち回りの組み合わせ」で自衛するフェーズだ。

- 米国:音声・肖像の無断複製を連邦法で禁じる「NO FAKES法」の施行が目前

- EU:AI法(AI Act)により、ディープフェイクには「AI生成であること」の明示義務が課された

- 日本:2026年、「音声権」の新設を求める超党派の議論が加速中

FAQ

Q. AIに学習されない設定はある?

「AI学習禁止」とプロフィールに書くことに法的強制力はない。

ただし、技術的保護手段(ノイズ混入等)を回避しての学習は法30条の4の但書(不当に害する場合)に抵触する有力な証拠になる。

Q. 似た声で歌われたら損害賠償を請求できる?

単に「似ている」だけでは請求できない。

あなたの「名前」を無断で使い、あたかもあなたが歌っていると誤認させて収益を得ている場合に限り、パブリシティ権侵害として請求できる。

Q. 「透かし」があれば勝手に使われない?

透かし(SynthID等)は「AI生成であること」を証明するもので、盗用自体を防ぐものではない。

しかし裁判時の有力な物証になる。

Q. Content Credentialsはどうやって使う?

Adobeの「コンテンツ認証イニシアチブ(CAI)」に対応したツール(Adobe Photoshop・Premiere等)で制作した場合、C2PAメタデータが自動付与される。

SNSやWebに公開する際にこのデータが「本物の証明」として機能する。

まとめ

- 日本の著作権法:声そのものを保護していない。武器は「パブリシティ権」と「人格権」

- 主要サービスの差:Adobe>Google Lyria>Suno/Udioの順で権利保護レベルが異なる

- 被害時の5ステップ:証拠保全→プライバシー侵害通報→弁護士名義削除通知→開示請求→SNSで本物の証明を固定

- 世界の動向:NO FAKES法・EU AI Act・日本の音声権議論と法整備が加速中

- 今すぐできること:Content Credentialsで作品に認証情報を付与し、本物の証明を積み上げておく

守れるのはあなた自身の「仕組み」だけだ。ルールを知り、技術で補完し、最悪を想定する。この3点セットを今日から始めてほしい。